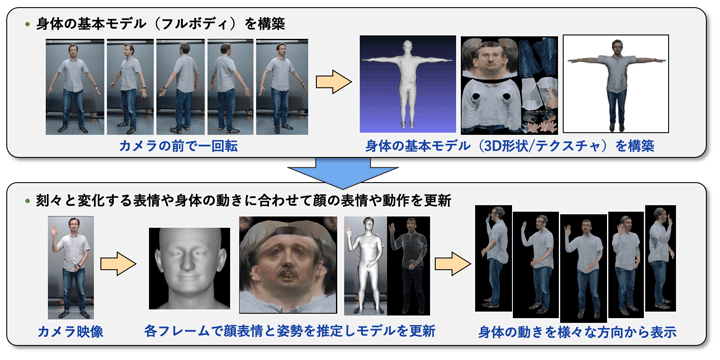

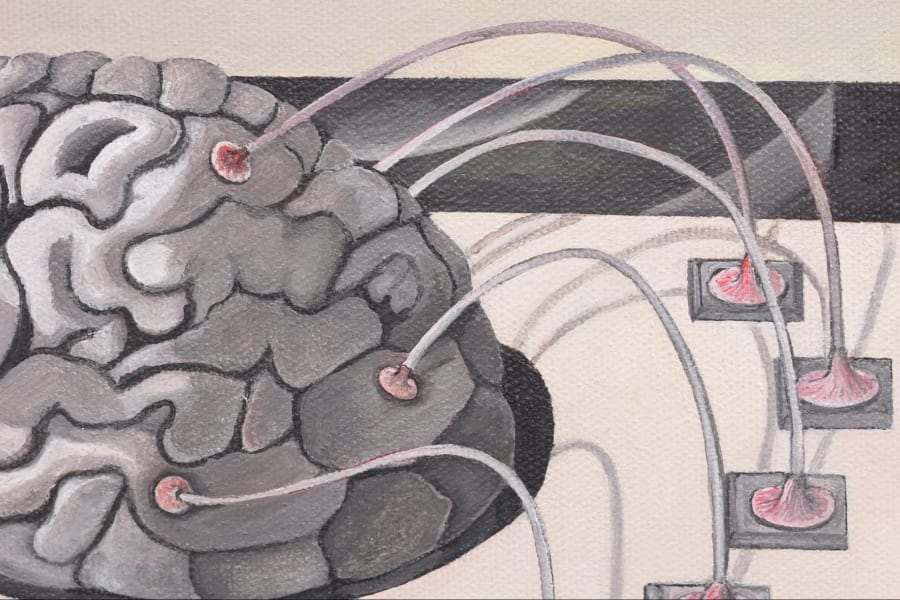

CGキャラクターでなく「リアルな3Dアバター」が必要

現在、仮想空間(メタバース)や複合現実(MR)のなかで、自らの3Dアバターを使い、遠隔コミュニケーションを行う技術が世界各地で開発・改良されています。

しかし現時点での3Dアバターは、あらかじめ作られた、自分の姿とはまったく異なるCGキャラクターを使うことがほとんどです。

そのため、刻々と変化する表情や動作の再現ができず、コミュニケーションにおける相互理解の妨げとなっていました。

また、仕事の場としてメタバースを利用していく未来を考えた場合、CGキャラクターが集まって重要な会議をするわけにはいかないでしょう。

そこで、”本人の姿をもとにしたリアルな3Dアバター”の必要性が高まっています。

ところが、その3Dモデルの構築には、多数のカメラや、位置・奥行きを検出する特殊なセンサーなど、大規模な設備が必須であり、個人が手軽にカメラ1台で作成することは困難でした。

カメラ1台でフルボディの3Dアバターを生成

しかし今回、NICTの研究チームは、カメラ1台の映像のみを材料に、自身のフォトリアリスティックな3Dアバターを構築する技術「REXR(レクサー)」の開発に成功しました。

手順は次のとおり。

まず、カメラの前で一回転した本人の映像から全身モデルを作成します。

次に、カメラの前で本人が動くと、顔の表情や身体動作がAIにより推定され、モデルを更新。

こうして、表情や動作の変化をどの方向からでも、入力映像と同レベルで細かくリアルタイムに再現するアバターの完成です。

アバターが細かな表情やボディランゲージを再現してくれるため、非言語情報を相互に読み取ることができ、遠隔コミュニケーションの充実度が高まると期待されます。

REXRを仮想空間における多人数のオンライン・ミーティングに実用できれば、重要な会議やビジネス交渉も、まるでその場にいるかのようなリアルさで行えるでしょう。

まだまだコロナの収束が見えず、世界情勢も不安定な今こそ、リモートでも互いの親密度を深められるREXRのような技術が必要かもしれません。

![BLACK WOLVES SAGA -Weiβ und Schwarz- for Nintendo Switch 【メーカー特典あり】 [予約特典]スリーブケース](https://m.media-amazon.com/images/I/51CzLR9fW3L._SL500_.jpg)