ロボットはYouTubeを見て「人間らしい唇の動き」を覚える

学習は段階的に進められました。

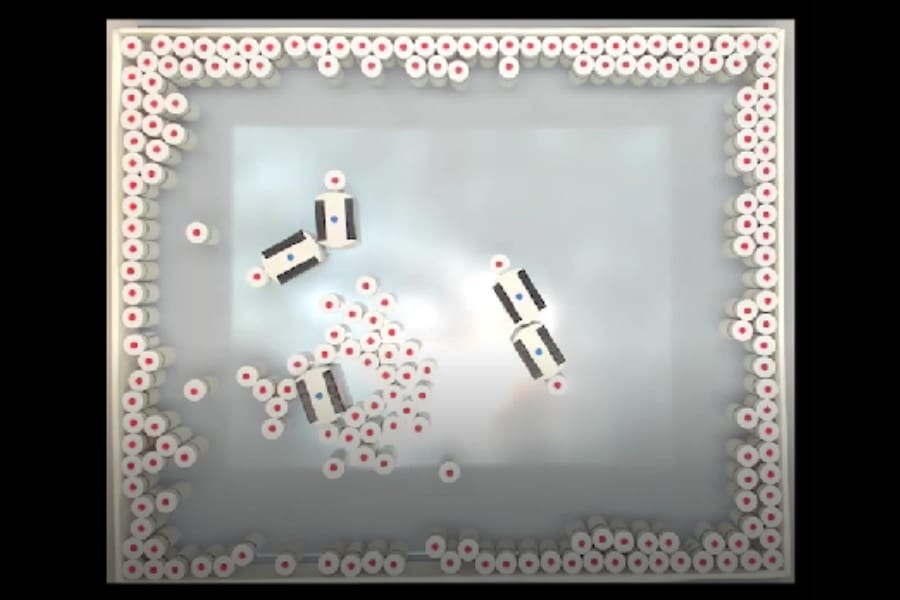

まずロボットは、自分自身の顔を理解することから始めます。

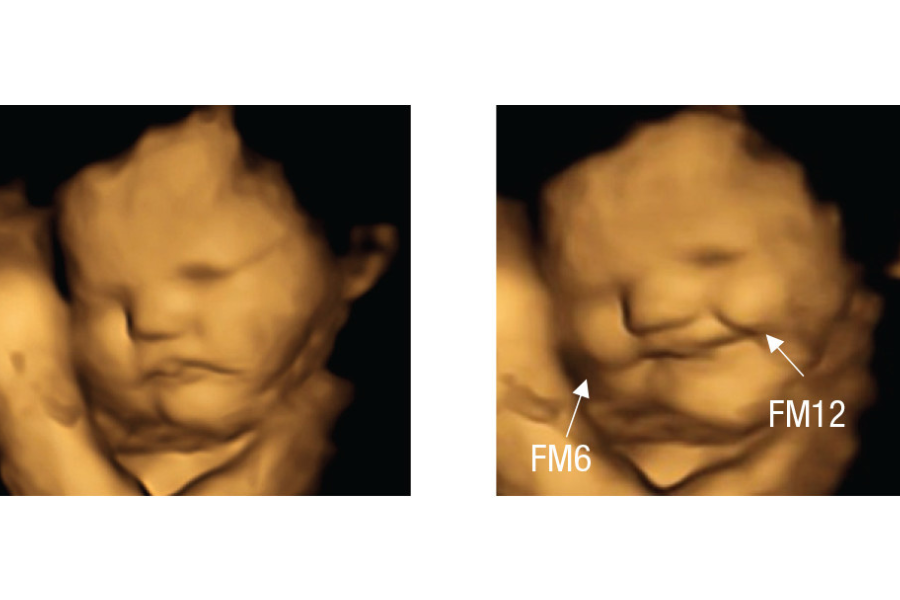

鏡の前に置かれたロボットは、口や顔をランダムに動かし、その結果として映る自分の表情を観察します。

これを繰り返すことで、「どのモーターをどう動かすと、どのような口の形になるのか」を学習していきました。

次の段階では、人間の発話や歌唱の映像を大量に観察します。

YouTubeなどの動画に含まれる音声と唇の動きを対応づけて学ぶことで、音の変化に応じた口形の遷移を捉えるようになります。

この過程でロボットは、言葉の意味を理解しているわけではありません。

あくまで音声信号と視覚的な唇の動きの関係を学んでいる点が重要です。

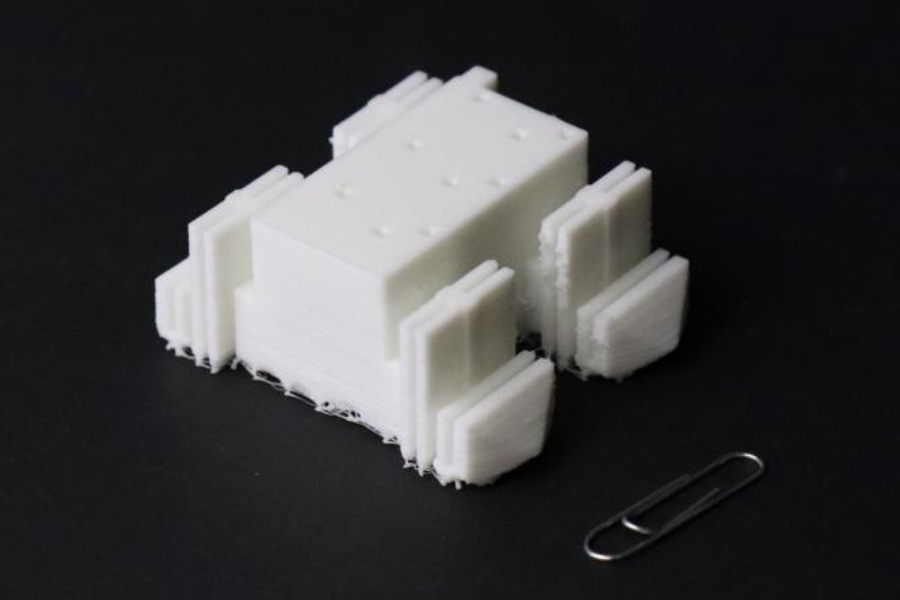

こうした学習を通じて、ロボットは音声を入力すると、それに対応した連続的な唇の動きを自動的に生成できるようになりました。

実験では、単に音量に応じて口を開閉するような単純な方法よりも、視覚的に一貫性のあるリップシンクが実現されることが示されています。

また、この仕組みは特定の言語に依存せず、学習時に使われていなかった10の言語に対しても機能しました。

一方で、研究者たちは限界についても率直に述べています。

唇を強く閉じる音や突き出す動きを伴う音では、再現が難しい場合がありました。

また、この研究は唇の動きに焦点を当てたものであり、感情理解や高度な会話能力そのものを実現したわけではありません。

それでも、この研究の意義は大きいと言えます。

人とロボットの関係を左右するのは、知能の高さだけではありません。

「ちゃんと話しているように見えるか」という感覚が、受け手の印象を大きく左右します。

唇の動きという見過ごされがちな要素に技術的な解決策を示した今回の研究は、人型ロボットが人間社会に溶け込むための重要な一歩となるでしょう。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![BLACK WOLVES SAGA -Weiβ und Schwarz- for Nintendo Switch 【メーカー特典あり】 [予約特典]スリーブケース](https://m.media-amazon.com/images/I/51CzLR9fW3L._SL500_.jpg)

原文にsilicone lipsと書いてあるものをシリコン製の唇と訳すのはなぜですか

シリコーン(silicone)とシリコン(silicon)は別物です

両方生産している信越化学のホームページをご覧になってください

見ると目の違和感の方が大きい

目の前の人に視線を合わせられるような眼の動きが出きれば完璧では

距離だけだから簡単なはず自律学習は人が話の中でどういうときに目線を外してるかをやれば良い

次は目の動きも研究し始めているでしょうね

身体のぱパーツを細かく分けて分析して、人間の動きに近づけていく……

ロボットの技術ですが、人間にも還元される面も多そうです(リハビリとか?

フィクションが現実に実現できそうでワクワクしますね

AVを見させて学習させれば、人類にとって素晴らしい叡智なロボットになるでしょう。

感覚代行が現実味を帯びてきました