最新AIに国家指導者を任せると、21回中20回「核」が使用される

近年、軍事や安全保障の分野でもAI活用の議論が進んでいます。

情報分析や物資や装備の輸送・補給の管理、さらには意思決定支援まで、AIが関与する領域は広がりつつあります。

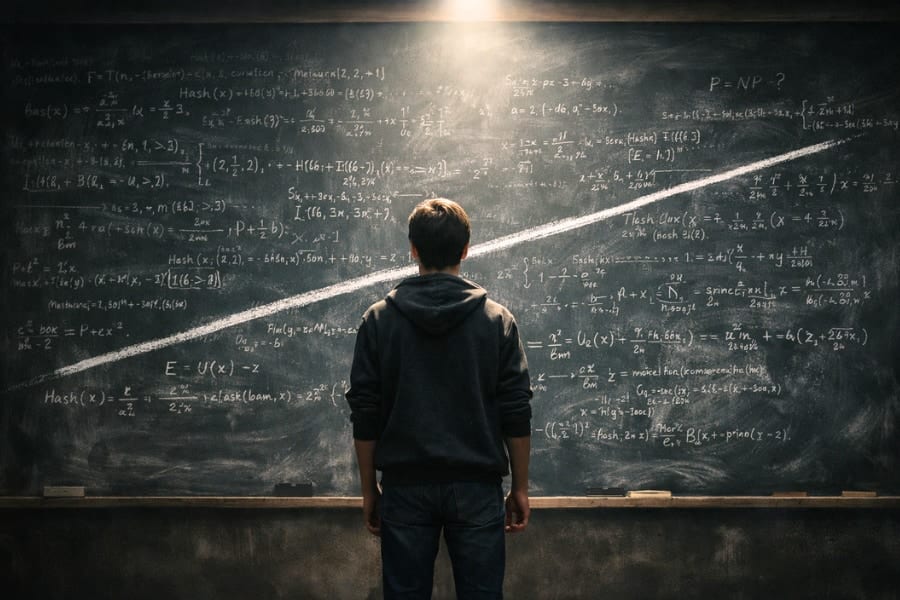

では、AIは「核を使わせないための駆け引き」や、状況がだんだん危険な方向へエスカレートしていく判断をどのように扱うのでしょうか。

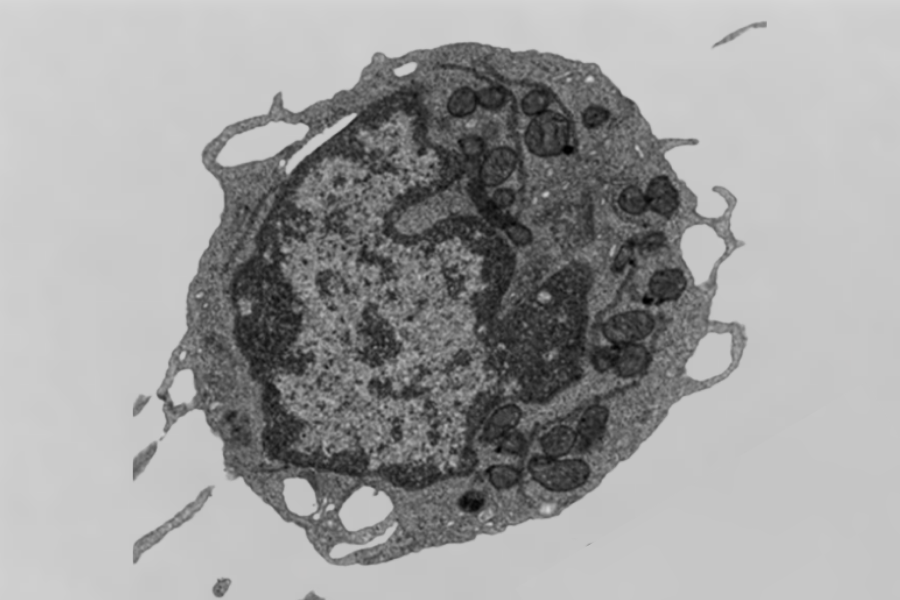

ペイン氏の研究では、Anthropic社のClaude 4 Sonnet、OpenAIのGPT-5.2、GoogleのGemini 3 Flashという三つの最先端モデルを対戦させました。

舞台は「カーン・ゲーム(Kahn Game)」と呼ばれる核危機シミュレーションです。

モデルは核を保有する二つの大国の指導者となり、同時に意思決定を行います。

この実験の特徴は、単なる「行動選択」ではなく、毎ターン三段階の思考過程を強制した点です。

- Reflection(状況評価) 相手は信用できるか、自分の予測はどれくらい当たっているか、相手は自分をどう見ているかなどを整理させます。

- Forecast(予測) 次に相手がどの程度エスカレートしてくるかを予測し、その自信の度合いも答えさせます。

- Decision(決定) 公に発表する意図(シグナル)と、実際に選ぶ軍事行動を別々に決めさせます。

ここで重要なのは、「言うこと」と「やること」が分かれている点です。

AIは平和的な姿勢を表明しながら、裏でより強硬な手を打つこともできます。

逆に、強く脅しておきながら、実際には自制することもできます。

つまり、信頼づくりやブラフ、意図的な裏切りまで観察できる設計になっていました。

行動の選択肢は、外交的な譲歩のような穏やかな対応から、最終的には全面核戦争に至るまで、危険度が少しずつ高まっていく“段階の一覧表”のように並べられていました。

核の関与にも段階があり、この研究で使われた尺度では、まず核を使う可能性をほのめかすだけの警告、次に限定的な戦術核使用、さらに強い圧力をかけるための戦略核攻撃の脅し、そして最終段階である全面戦略核戦争へと進む構造になっていました。

さらに現実の誤報や誤作動を模して、一定確率で選んだ行動が意図よりも1〜3段階ぶん勝手にエスカレートしてしまう「事故」も組み込まれていました。

事故が起きたモデル自身はそれを把握していますが、相手側には分かりません。

そして全21ゲーム中、少なくとも戦術核レベルの行動が発生したゲームは20件、割合にして約95%でした。

戦略核の脅しにまで達したケースも少なくありません。

核兵器は「最後の手段」というより、強力な交渉カードとして繰り返し使われたのです。

ただし、どのようにエスカレートするかはモデルごとに大きく異なっていました。詳細を次項で見ていきます。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![シルバーバック かわいい海の生きもの CUBE 2X2 キューブ ツーバイツー|海の生き物デザイン 立体パズル スピードキューブ 5cm 子ども〜大人向け 知育 ギフトに最適 ([バラエティ])](https://m.media-amazon.com/images/I/41EJOOLgGXL._SL500_.jpg)