AI音声は見抜けるのか?自覚がなくても「脳」は分かっている

近年のAI音声合成は、以前のような機械的な声とは大きく異なります。

現在の技術では、声の高さや抑揚、話すリズム、息づかいに近い要素までかなり自然に再現できます。

そのため便利な技術である一方で、電話詐欺やなりすましに使われる危険も高まっています。

そこで研究者たちは、「人間はAI音声と人間の声を本当に区別できるのか」を確かめようとしました。

実験には30人が参加しました。

参加者は、人間の声とAIが生成した音声を聞き、「これは人間か、AIか」を判断します。

AI音声の作成には「GPT-SoVITS」という音声合成モデルが使われ、追加学習によって特定の人の声により近づけたものと、追加学習をしていないものの2種類が用意されました。

実験は三つの段階で行われました。

まず参加者は、何のヒントもない状態で音声を聞き、人間かAIかを答えます。

その後、約12分間の訓練が行われました。この訓練では、「赤ずきん」などの童話要約を使い、聞こえてくる音声が「人間」か「AI」かを表示しながら聞かせました。

つまり、答えを示しながら違いを学ぶ時間です。

最後に、再び判別テストが行われ、判別テストでは、短い文章を使って人間の声かAI音声かを答えさせています。

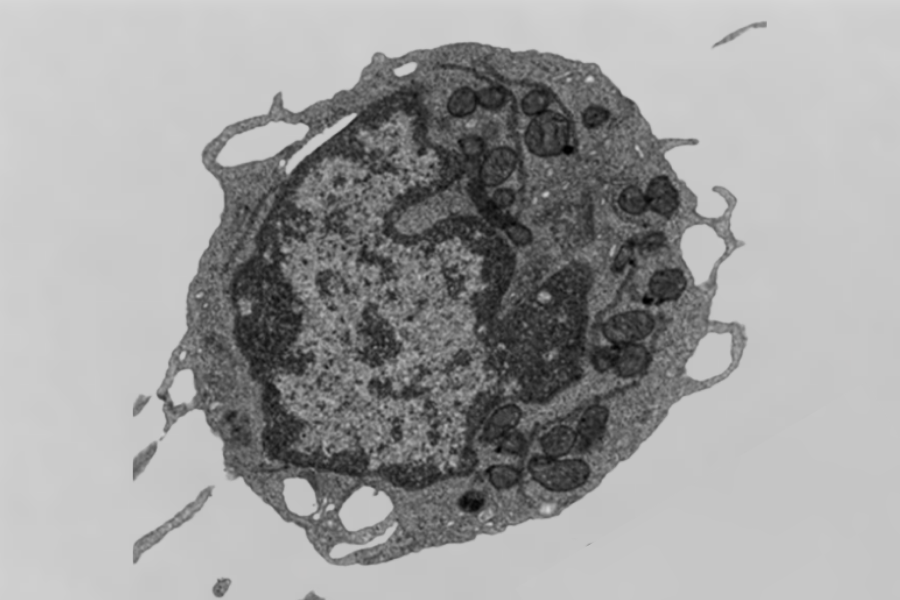

さらに参加者は、実験中ずっとEEG(脳波測定装置)を装着していました。

研究チームは、参加者が正しく判断できるかだけでなく、音声を聞いたとき脳がどう反応するかも同時に調べたのです。

その結果は少し意外なものでした。

参加者はAI音声と人間の声をあまりうまく見分けられず、12分の訓練の後も、判別の正確さは大きくは上がりませんでした。

しかし興味深いのは、脳波解析では、訓練後に人間の声とAI音声への反応の違いが見られたことです。

より詳しい結果を次項で確認しましょう。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![シルバーバック かわいい海の生きもの CUBE 2X2 キューブ ツーバイツー|海の生き物デザイン 立体パズル スピードキューブ 5cm 子ども〜大人向け 知育 ギフトに最適 ([バラエティ])](https://m.media-amazon.com/images/I/41EJOOLgGXL._SL500_.jpg)