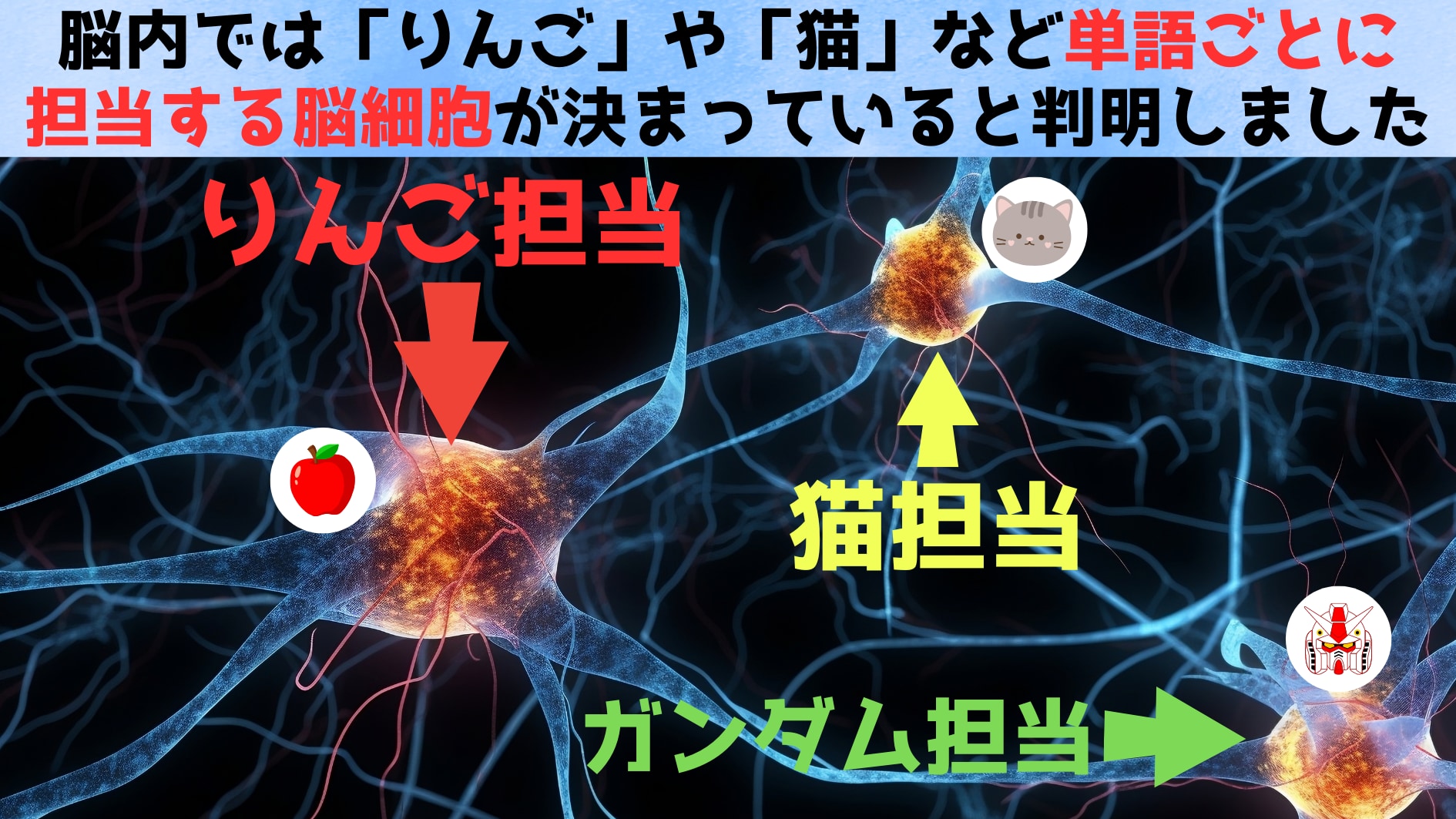

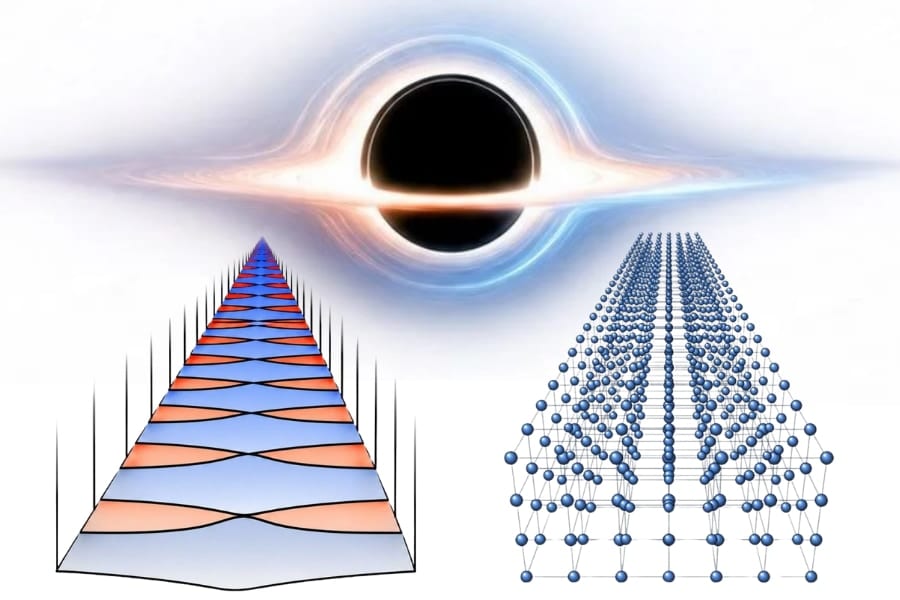

脳細胞は機械的に単語に反応しているわけではない

異なる単語をカテゴリー分けする能力は文章理解において非常に重要です。

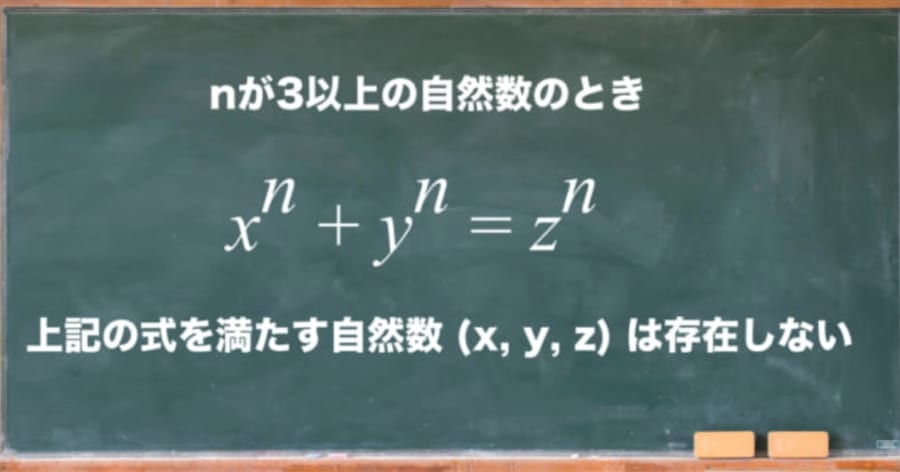

しかし、ただ単語を区別するだけでは、同音異義語に対処できません。

たとえば「アイ」と聞こえる音声が英文にあった場合、単独では「I(私)」なのか「eye(目)」なのかを区別できません。

日本語で言えば「ハシ」とだけ聴いただけでは「橋」なのか「箸」なのかがわからないのと同じです。

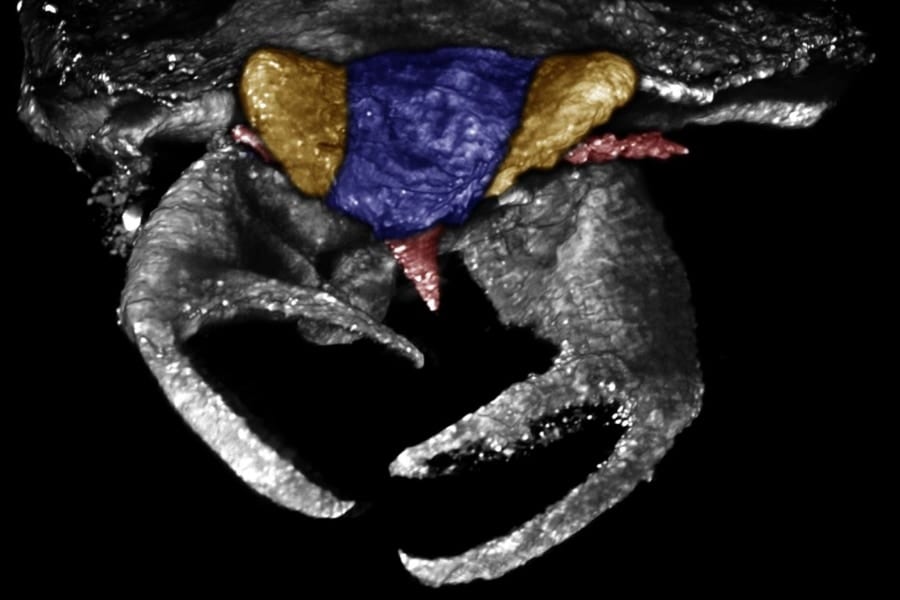

研究では脳はこの問題に対してどう対処しているかが調べられました。

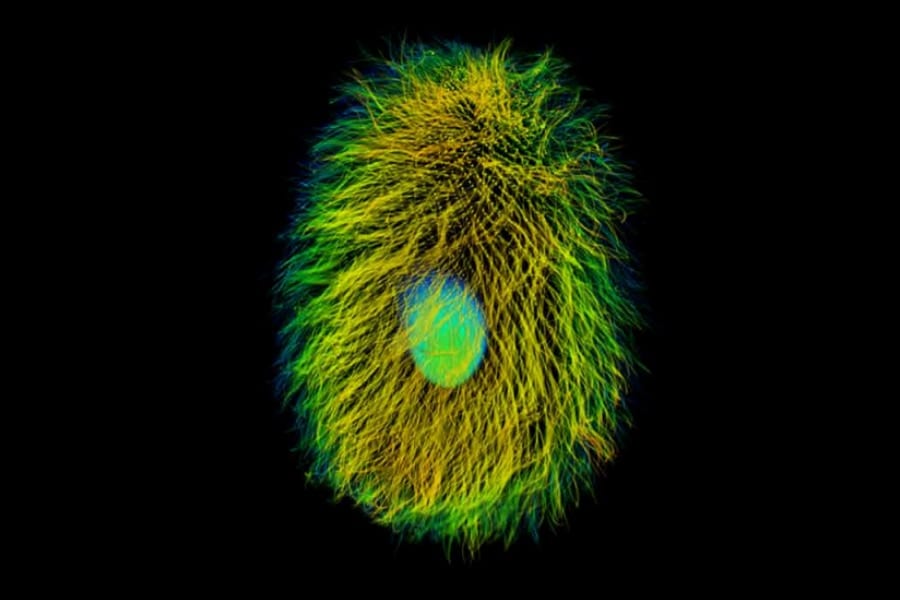

すると各単語に紐づいたニューロンは単語音声に機械的に反応するのではないこともわかりました。

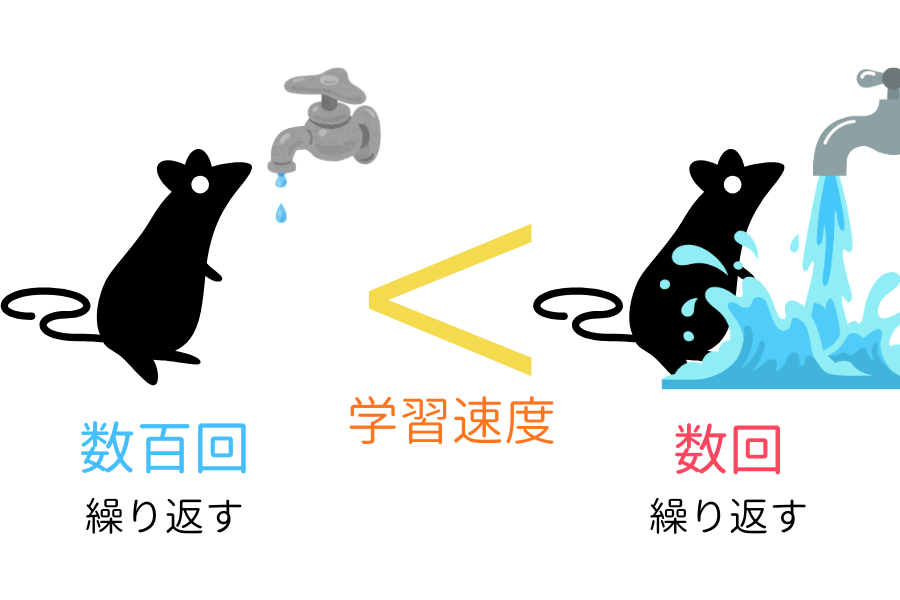

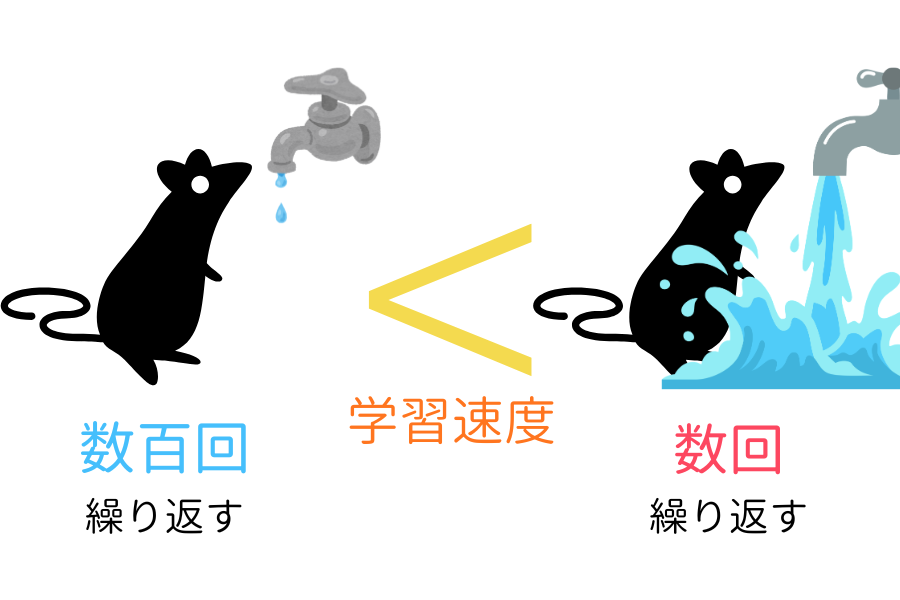

具体的には、私たちの脳は個々の単語をカテゴリー分けするだけでなく、前後の単語の情報を参照することで、「ハシ」と聞こえた単語が「橋」なのか「箸」なのかを理解していることがわかりました。

「文脈から意味を推測するのは基本中の基本」と言う人もいるでしょう。

しかし脳内において実際にその言葉通りの情報処理が行われていることが確認されたのは大きな発見と言えます。

ブラックボックスとされていた脳細胞の個々の働きを検知する技術は、VRや医療においても重要な役割を果たしていくでしょう。

もし脳細胞の活動をAIを挟んで文章として送り届けることができれば、より正確な「Brain to Brain」コミュニケーションが実現するかもしれません。

Iとeyeは日本人が聞いても明らかに違うと思うんだ…

私はそうは思いませんし論点はそこではありません

論点と違うのを承知の上で調べてみた。

Cambridge dictionaryによると、Iはeyeと発音するらしいぞ。

https://dictionary.cambridge.org/ja/pronunciation/english/i

単語と脳細胞の対応、意味との関係、単語の階層性(上位概念と下位概念)などの更に詳しいことは、清野 躬行著「脳のシステム.アーキテクチャー」(講談社エディトリアル刊)に書いてあるのでご覧ください。