バイブコーディングの問題

バイブコーディングは、AIによってコードを自動生成する利便性をもたらしますが、そのスピードと量の多さゆえにバグやセキュリティ上の脆弱性が見逃されやすいリスクも抱えています。

生成されたコードがブラックボックス化している場合、どのようなライブラリを内部で参照しているかを把握しにくいのも懸念材料です。

したがって、自動テストや静的解析、レビュー体制などをより厳密に運用し、早い段階でバグや脆弱性を排除できる仕組みを整えなければなりません。

さらに、著作権やライセンスに関わる問題も増えています。

AIの学習データに含まれていたコードがそのまま生成される可能性や、どのコードがどのようなライセンスで使われていたのかを追跡しづらいといった課題は、意図しない著作権侵害を引き起こすリスクがあります。

加えて、AIが生成したコードに重大な不具合や法的問題が生じた場合、エンジニアや企業、AIツールの提供元のいずれが責任を負うのかという点については、まだ明確なルールや法整備が十分ではありません。

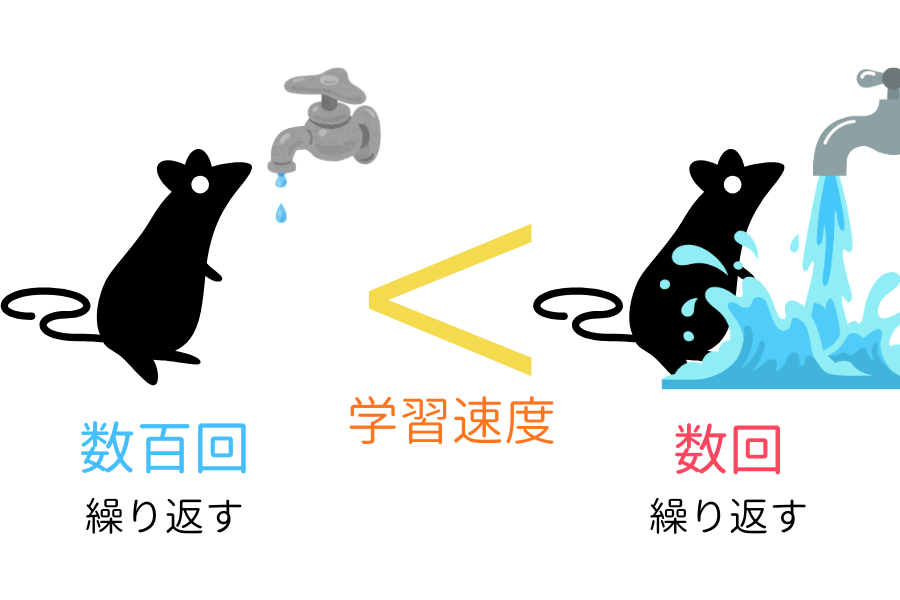

さらに近年、企業がバイブコーディングを積極導入することで、「少人数開発による人件費削減」と「ディレクタークラスの不足」という二重の問題が生まれる可能性も指摘されています。

単純なコーディング業務だけを担っていたエンジニアが失業するリスクがある一方、AIを指揮・監修できるエンジニアが不足する状況が同時に起こり得るからです。

結果として、“仕事が消える” だけでなく、“仕事の性質が変わる”という形で、雇用構造が大きく変化する可能性があります。

このように、バイブコーディングがもたらす革新には多くの利点がある一方、品質管理・セキュリティリスク、著作権問題、雇用への負の影響など未解決の課題が山積しています。

こうした問題に対処するには、以下のような多面的な取り組みが必要とされるでしょう。

開発現場でのレビュー体制やセキュリティ文化の強化

法律や倫理ガイドラインの整備

エンジニアの再教育やスキルアップ支援

バイブコーディングはソフトウェア開発のスピードと柔軟性を飛躍的に高める大きな可能性を持っていますが、その潜在力を持続的に生かすためには、社会や組織、そしてエンジニア個人が、これらの課題に正面から向き合い、適応を進めていくことが求められるでしょう。