なぜ聞き分けられない? 広がる社会的リスクも

なぜこれほどまでにAI音声は本物に近づいたのでしょうか?

研究で使われた「ボイスクローン」は、一般向けに市販されているAI音声合成サービス(ElevenLabs社の技術)を使用し、たった4分間の録音データから本人そっくりの声を生成しました。

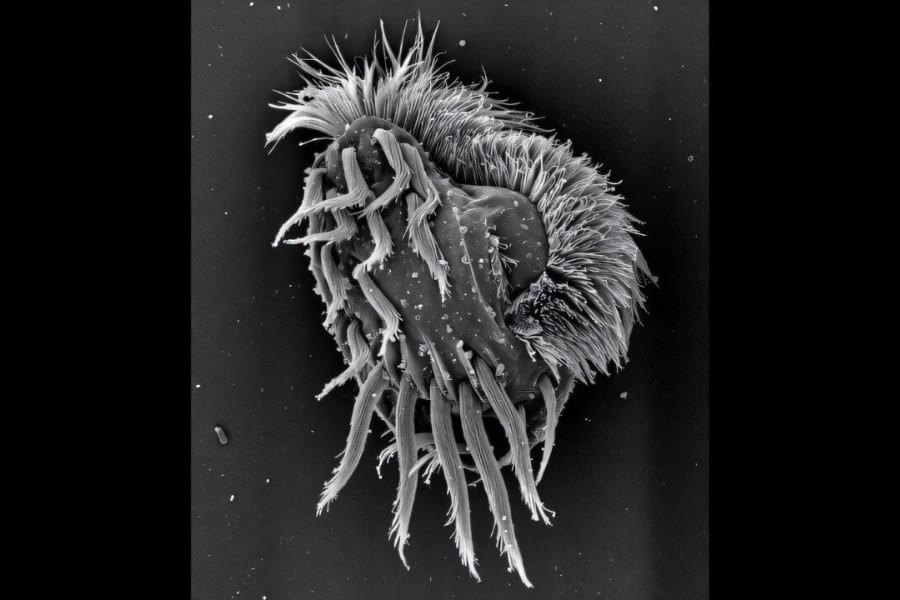

背景ノイズや話し方の癖まで忠実に再現するため、ほとんどの人は「違和感のない声」として聞いてしまうのです。

また、人間は“人の声”を聞いたとき、無意識のうちに「これは本物だ」と思い込む傾向もあります。

実験では、被験者の多くがAI音声であってもつい「人間の声だ」と判定しがちで、こうしたヒューマン・バイアスも判別の難しさを強めています。

この現象は、私たちの生活や社会にも新たなリスクをもたらします。

もし犯罪者がAIであなたの声をクローンし、銀行の本人確認を突破したり、家族や友人になりすまして詐欺を働いたりすることも技術的には可能になりつつあります。

実際、海外では既にクローン音声を使った詐欺事件も報告されています。

さらに政治家や有名人の発言を“捏造”するフェイク音声動画の危険性も現実味を増しています。

一方で、視覚障害者向けの音声ガイドや、声を失った人への「本人の声の再生」など、社会的に有益な活用も急速に進んでいます。

AI音声が“人間らしさ”を手にしたことで、その可能性とリスクはどちらも広がっているのです。

![クリーンプラネット [つけ置き強力洗剤] デトックス丸洗浄 プロフェッショナル 300g (衣類用漂白剤・非塩素タイプ)](https://m.media-amazon.com/images/I/51WGutdz9PL._SL500_.jpg)

![マイクロSDカード 512GB 高互換性 micro sdカード microSDXC メモリーカード 大容量 ミニSDカード 高速データ転送 TFカード SD変換アダプター付属 [並行輸入品]](https://m.media-amazon.com/images/I/516JSQaVLJL._SL500_.jpg)

スマホの通話音声がそもそもリアルタイムで合成されてる件について

前にその手のセールス電話が職場に着たが「要件を詳細に教えてくれ」と言っても、

「わかりません。◯◯の〜〜ですが社長へ繋げろ」と着信直後のセリフを壊れたレコードのように延々と繰り返すだけのポンコツだった。とても不快だった。

AIチャットもそうだが単純な事を質問する分には答えられるが、インプットされてないものや枕詞、別の言い回しにとにかく弱い。あと解釈違いへの謝罪もせず流暢に突っ走るのも動画でよく見かけた。

結局人対人であれば即答できる程度でボロを出す。まだまだ人間の感情を含めた言葉は制覇できないようだ。

音声技術の発達はすごいねえ…

合成音声はボカロやいわゆるゆっくり音声を始めとした日本が引っ張ってきたようなものだけどAI使っただけで本当にその域まですぐ達されたならちょっと怖いと言うか。

歌はAIが絡むと思い通りの調声ができないって人も多いし奪われないだろうけどトークソフトの立ち位置が消えるのは悲しいかも。

まあリアルなら良いってもんじゃないし日本の合成音声は大体キャラが付属するのでそんなすぐAI音声染めにはならんと思うが。

大抵の人はハイテンションで喋らない限りおおきな抑揚つけない棒読みだから普段の会話のクローニングは簡単だろうな