意図を共有し、目標物を視認できれば「他者が操作する腕」の自己身体感は高まる

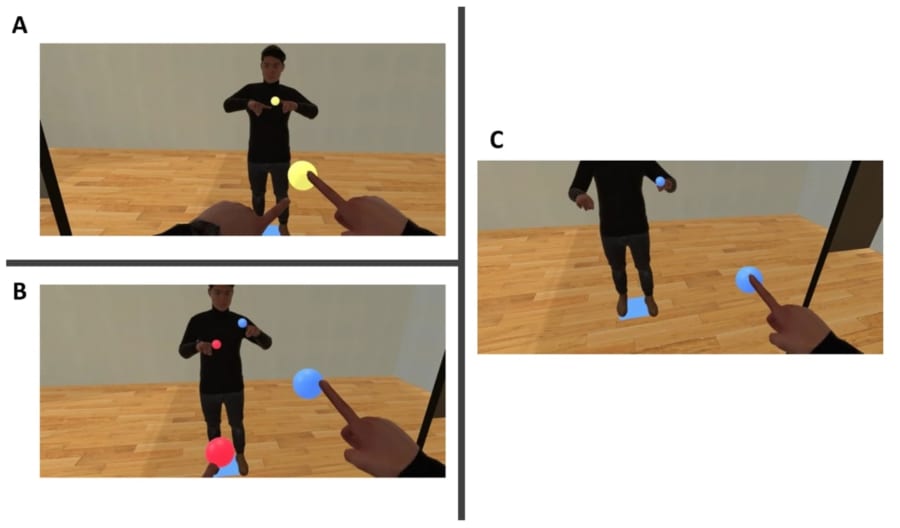

別の実験では、2人で操作するアバターを使って、ランダムな位置に出現する目標物体に両手で触るよう求められました。

自分が操作できるのは片方の腕だけですが、パートナーが操作する腕を見ながら、共通の意図をもってタスクをこなすのです。

これ以外にも、別々の目標物体を触るケースや、相手の目標物体が見えないケースでも実験が行われました。

その結果、皮膚コンダクタンス反応と同様、行為主体感(自身の行為を自分で起こしたものだと感じること)と身体所有感(自分の身体部位を見たときに、それが自分の体の一部だと感じること)は、他者が操作する腕と比較して、自分で操作する腕に対して有意に高くなりました。

自分で操作する腕の方が自己身体感が高いのは、当然だと言えますね。

ただし、この実験では次の点も明らかになりました。

「1つの目標物体に触れる」という共通の意図がある場合や、他者の目標物体が見える場合には、他者の目標物体が見えない場合に比べて、他者が操作する腕に対する行為主体感や身体所有感が有意に高くなったのです。

つまり、他者の意図を予測するための視覚情報があれば、他者に制御された腕であっても自己身体感をいくらか向上させられるということです。

研究チームは、この結果が、マルチタスクの効率化や障がい者支援に役立つと考えています。

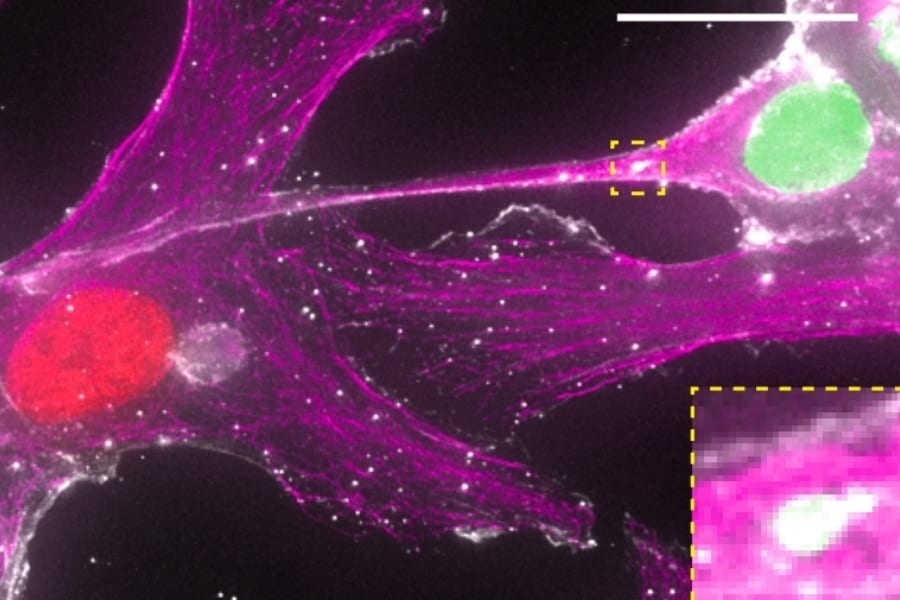

例えば、自立駆動型の義肢を装着すると、一般的にユーザーは自分の意志と関係なく動く義肢に対して違和感を覚えるものです。

しかし今回の研究結果から、義肢の目標や意図をユーザーに共有・視認させることで、違和感の軽減につながる可能性があると分かります。

新しい可能性を生み出すVR実験。研究は現在も進行中なので、今後の進展にも期待したいですね。

![クリーンプラネット [つけ置き強力洗剤] デトックス丸洗浄 プロフェッショナル 300g (衣類用漂白剤・非塩素タイプ)](https://m.media-amazon.com/images/I/51WGutdz9PL._SL500_.jpg)

![マイクロSDカード 512GB 高互換性 micro sdカード microSDXC メモリーカード 大容量 ミニSDカード 高速データ転送 TFカード SD変換アダプター付属 [並行輸入品]](https://m.media-amazon.com/images/I/516JSQaVLJL._SL500_.jpg)