簡単な文章を元に3Dモデルを生成するAIシステム

画像生成AIが最初に登場して以来、このツールは瞬く間に世界中に広がりました。

現在進行形でその技術は向上しており、「AIが出力した画像」と「クリエイターが描いた絵」の見分けがつかないケースも増えてきました。

もちろんAIの画像にはAI特有の傾向や様々な欠点が見られますが、簡単な指示だけで瞬時に何パターンもの画像を生成してくれる点は、人間では成しえない強みだと言えます。

OpenAI社は2D画像で起きているこの現象を、3Dモデルの分野でも生じさせようとしています。

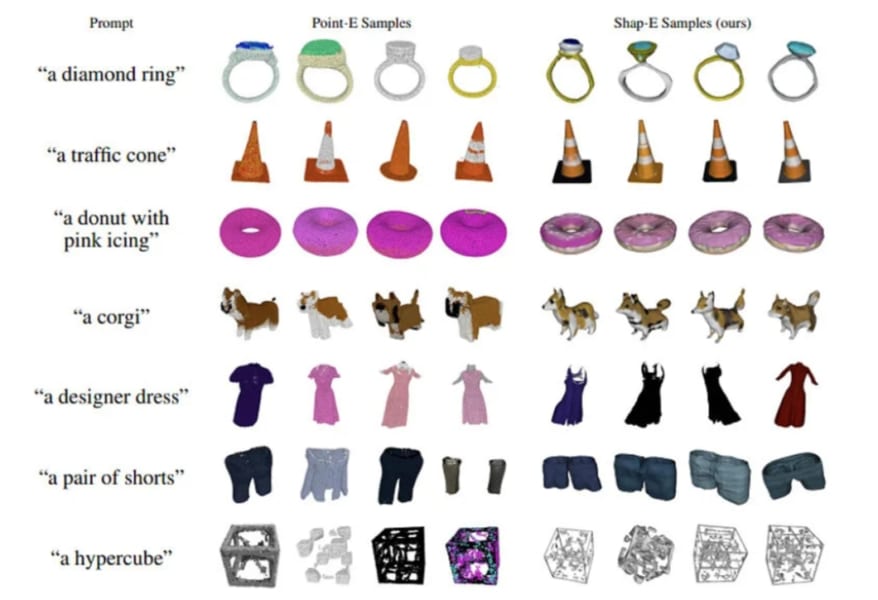

彼らは2022年の12月、3Dモデルを生成するAIシステム「Point-E」をリリースしました。

Point-Eは3D点群(3次元座標を持つ点データの集合)により3Dモデルを生成します。

これは文字通り小さな点が集まってできた3Dモデルであり、サンプルを見る限りでは、お世辞にも質が良いとは言えません。

ところがそれからわずか数カ月後、OpenAI社は3Dモデルを生成する新しいAIシステム「Shap-E」をリリースしました。

Shap-EはPoint-Eとは異なり、陰関数によって形状を表現しているため、従来のシステムよりも複雑で正確な3Dモデルを生成できます。

Point-EとShap-Eが生成したモデルを比較すると、質の違いは明らかですね。

しかもこれらは、人間が短い文章もしくは画像で指示を与えるだけで、瞬時に生成されるというのだから驚きです。

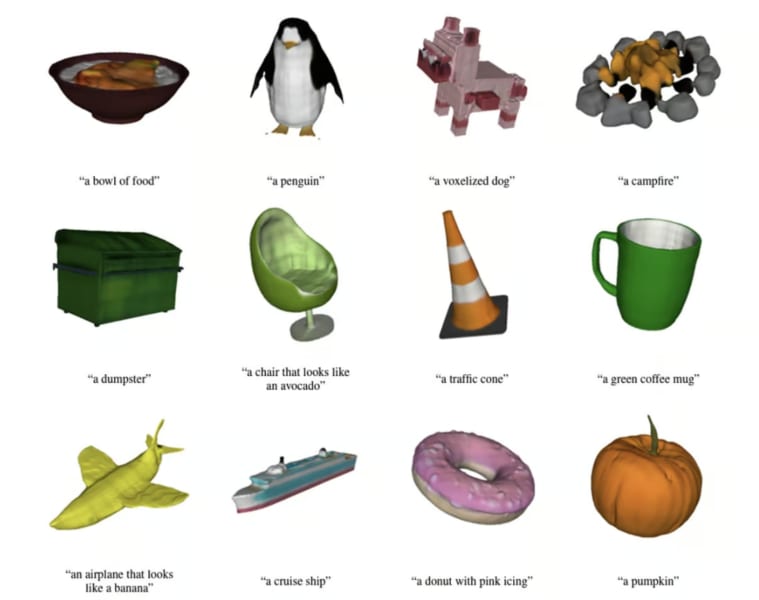

「ペンギン」「緑のブーツ」などの一般的なワードだけでなく、「アボカドみたいな椅子」「バナナみたいな飛行機」といった現実にはない独自のデザインも生成可能です。

もちろんPoint-Eから大きく進化したとはいえ、Shap-Eが生成する3Dモデルのサンプルのレベルは高くありません。

かなり昔のゲームであれば違和感はありませんが、現代レベルのモデルではないでしょう。

それでもShap-Eは様々な可能性を秘めており、今後の応用を考えると、技術者だけでなく、一般ユーザーですらワクワクできます。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![【Switch】Sullyland Nursery Rhyme 【メーカー特典あり】 [初回封入特典]デジタルボイスドラマ 同梱](https://m.media-amazon.com/images/I/51PFrMXm-rL._SL500_.jpg)