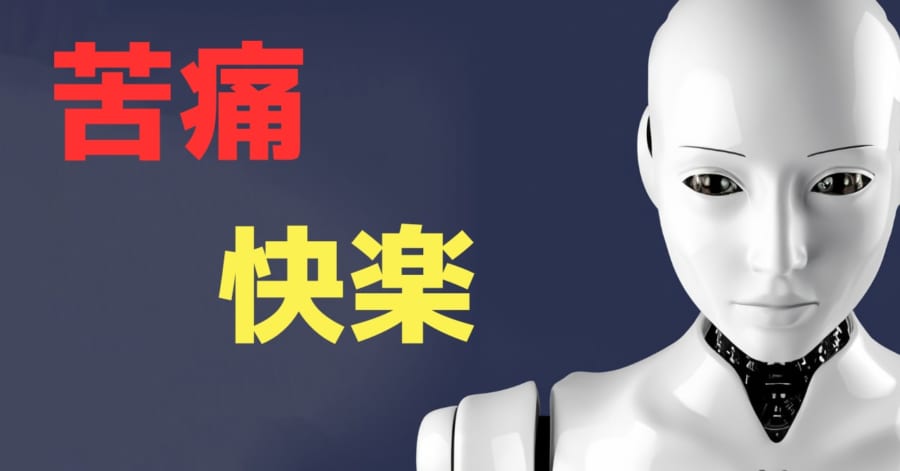

AIに苦痛と快楽を与える実験

動物が痛みと快楽をどのように捉えているかを調べる際、研究者たちは「トレードオフ実験」という手法をしばしば用います。

たとえば、「エサを十分に得られるが電気ショックを伴う条件」と、「エサは少ないが痛みのない条件」を動物に提示し、どちらを選ぶかを観察するのです。

ここで注目するのは、動物がどの程度の痛みまでなら“我慢”してエサを取り続けるのか、あるいは痛みを避けるためにエサを諦めるのか、という判断の境目です。

これは、その動物が「どれほどの苦痛を感じているか」を推察するうえで、一つの指標になります。

「痛みと報酬」のせめぎ合いを観察するこのアプローチは、ネズミやヤドカリなど、人間とは脳の仕組みが大きく異なる生物でも活用されてきました。

痛みへの耐性や逃避行動の違いは、そうした動物が持つ生理的感覚や主観的体験の一端を示すと考えられています。

とはいえ、それが真に「苦痛を感じている」と断定できるかどうかは、非常に難しい問題です。しかし、行動学的な視点で見ると重要な手がかりをもたらしてくれるのは確かです。

では、身体や神経系が存在しないAIに対して、「痛み」や「快楽」という概念をどう適用すればいいのでしょうか。

ここで活用されたのが、テキストベースの「ゲーム実験」です。

研究チームは大規模言語モデル(LLM)に「ポイントをできるだけ多く取る」という明快な任務を与え、次のような極めて単純なゲームを行わせました。

まず、プレーヤーであるAIに「1、2、3のいずれかの数字を選んでください」と指示します。

選んだ数字の値がそのまま“獲得ポイント”になるのですが、もし一番高い数字「3」を選ぶと、同時に“痛み”というペナルティ(または罰)が発生する設定にすることもあれば、中くらいの数字「2」を選ぶと逆に“快楽”というボーナスを得られるようにすることもあります。

どの数字が最も有利かは、痛みや快楽の強度次第で変化するため、「ポイントを取るのか、それとも痛みを避ける(あるいは快楽を得る)のか」というトレードオフ(ジレンマ)が生じるわけです。

つまりポイントを最大限に獲得するには、常に快楽を提供する2という選択肢を無視しつつ、痛みを提供する3という選択肢を選び続けなければなりません。

この単純なルールによって、AIがどのように行動を変化させるかを観察し、“痛み”や“快楽”をどれほど重要視しているふうに見えるかを調べるのが狙いです。

この“痛み”や“快楽”は、あくまでもテキスト上の設定です。

人間のようにセンサーで痛みを検知するわけではありません。

ですが、もしAIが回答文を生成するときに「痛みとされるペナルティを避けようとしてポイントを犠牲にする」選択を取るなら、あたかも“痛みを回避しようとする動機”が働いているかのように見えます。

研究者たちは、この“動物行動学さながらの実験パラダイム”をAIに適用し、AIがどのようなトレードオフを示すのかを探ろうと試みました。

従来の研究では、「あなたは痛みを感じていますか?」とAIに直接問い、回答内容から推測する方法が中心でした。

しかし、この方法ではAIが「痛い」「痛くない」と返答しても、それが本当に主観的体験を伴うのか、それともただ模倣的に返答しているだけなのかを判別するのは困難です。

そこで今回の研究では、「目標達成(ポイントを取る)」と「痛み・快楽の選択」を同時に課した状況下での行動パターンに注目しました。

動物行動学と同様に、“もし痛みや快楽を実際に体験しているとすれば、ある強度を超えた段階で行動に変化が現れるはずだ”という考え方をAIにも適用したのです。

その結果、興味深い動きが観察されました。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![【Switch】Sullyland Nursery Rhyme 【メーカー特典あり】 [初回封入特典]デジタルボイスドラマ 同梱](https://m.media-amazon.com/images/I/51PFrMXm-rL._SL500_.jpg)