Point

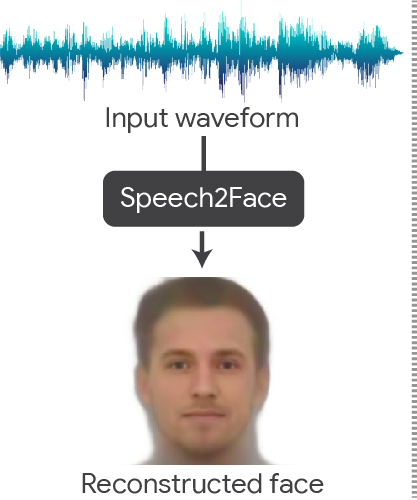

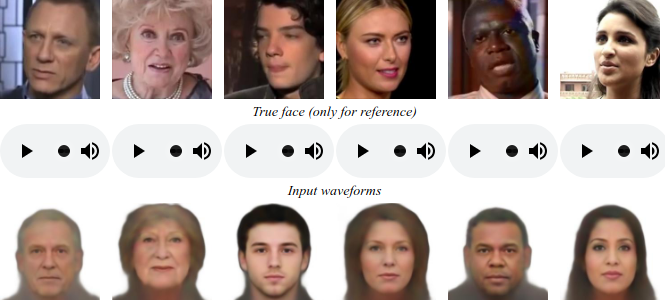

■音声情報から話者の顔を復元できる機能を持つAIが開発される

■この技術はAIに何百万人もの話者の動画をインプットさせ、声と顔の共通性を学習させることで可能となった

■声の波長域に共通する身体的特徴を抜き出して再構築する仕組みなので、厳密な個人の顔ではなく平均的な顔が生成される

アメリカ・カーネギーメロン大学の研究チームが、驚くべき能力を持つAIの開発に成功した。その名も「Speech2Face」。

このAI、なんと音声情報だけから話者の顔をほぼ正確に復元することができるという。

研究の詳細は、5月25日付けで「arXiv」上に発表されている。

https://arxiv.org/pdf/1905.10604.pdf

数百万人の「声」と「顔」のデータを学習

「Speech2Face」の機能は、短いボイスクリップを分析して、そこから話者にマッチする身体的特徴を選び出し再構築するものだ。

「声」と「顔」には強いつながりがあると考えられており、話し方や声のトーンには年齢や性別、民族性、言語のアクセントなどが大きく影響する。この考えをもとに研究チームは、インターネットやYoutube上にアップされている動画から何百万人もの話者の様子をAIに学習させた。

その際、データを「声」と「顔」に分けており、ある声のトーンや話し方に共通する話者の顔を予測できるように訓練した。

顔画像の生成には「GAN(Generative adversarial networks=敵対的生成ネットワーク)」が用いられている。

GANには「Generator(生成器)」と「Discriminator(識別器)」という2種類のネットワークが搭載されており、生成器は識別器に本物と誤認させられるような画像を生成する。対して識別器はそれに騙されないよう偽物を見分けようとする。

こうして互いを敵対させながらより正確な画像へと近づけていくのが「GAN」の機能だ。これはしばしば偽札を作る「犯人」とそれを見分ける「警察」との関係に例えられる。

偽札がバレた犯人はより本物に近いものを偽造し、またそれを警察が識別する。これを繰り返すと、ほとんど本物に近い偽札が出来るまで精度をあげることが可能となる。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![マモルーム お部屋まるごと予防空間 ダニ用 [2ヵ月用セット] ダニアレル物質の生成抑制・ダニを除去しやすくなる ダニよけ 加熱蒸散機 ダニ対策 (アース製薬)](https://m.media-amazon.com/images/I/413VgtLwPgL._SL500_.jpg)

![【Switch】Sullyland Nursery Rhyme 【メーカー特典あり】 [初回封入特典]デジタルボイスドラマ 同梱](https://m.media-amazon.com/images/I/51PFrMXm-rL._SL500_.jpg)