スマホ操作は「要求」から「予測」へ

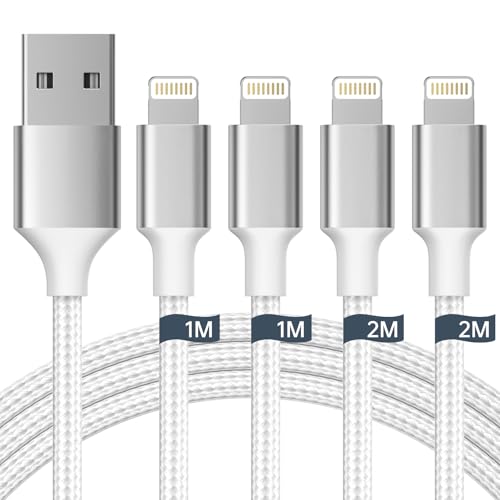

スマホの操作には画面のタップ、フリック、音声入力が一般的です。

決定をタップで行ったり、ページの切り替えをフリックで行ったり、「音楽を再生して」という要求を声で行ったり…。

つまり現在のスマホは、私たちが要求して初めて動作するものとなっています。

これでも登場時はかなり画期的な操作方法でしたが、多くの人はこの操作方法さえも煩わしく感じ始めているかもしれません。

そしてそんな人は、たぶんいちいち画面に手を載せなくても操作できる方法を求めているのではないでしょうか?

研究チームは、そんなもっと直感的で素早い操作のためにはユーザーが「要求」する前に「予測」することが大切だと考えています。

この「予測機能」は、既にさまざまな形で取り入れられています。

例えば、文字の予測変換は、私たちの文字入力をスムーズにしてくれます。

またYouTubeなどの「関連動画」は私たちが見たいものを予測したものであり、毎回の検索を省略してくれるでしょう。

では、スマホ操作を助ける新しい予測機能を生み出せるでしょうか?

研究チームは、視線を利用した予測に着目しました。

![シルバーバック かわいい海の生きもの CUBE 2X2 キューブ ツーバイツー|海の生き物デザイン 立体パズル スピードキューブ 5cm 子ども〜大人向け 知育 ギフトに最適 ([バラエティ])](https://m.media-amazon.com/images/I/41EJOOLgGXL._SL500_.jpg)

![【Switch】Sullyland Nursery Rhyme 【メーカー特典あり】 [初回封入特典]デジタルボイスドラマ 同梱](https://m.media-amazon.com/images/I/51wkUBGYzWL._SL500_.jpg)