ネットワーク内の物理現象を「記憶」や「学習」と解釈する

ネットワークに記憶力を発見

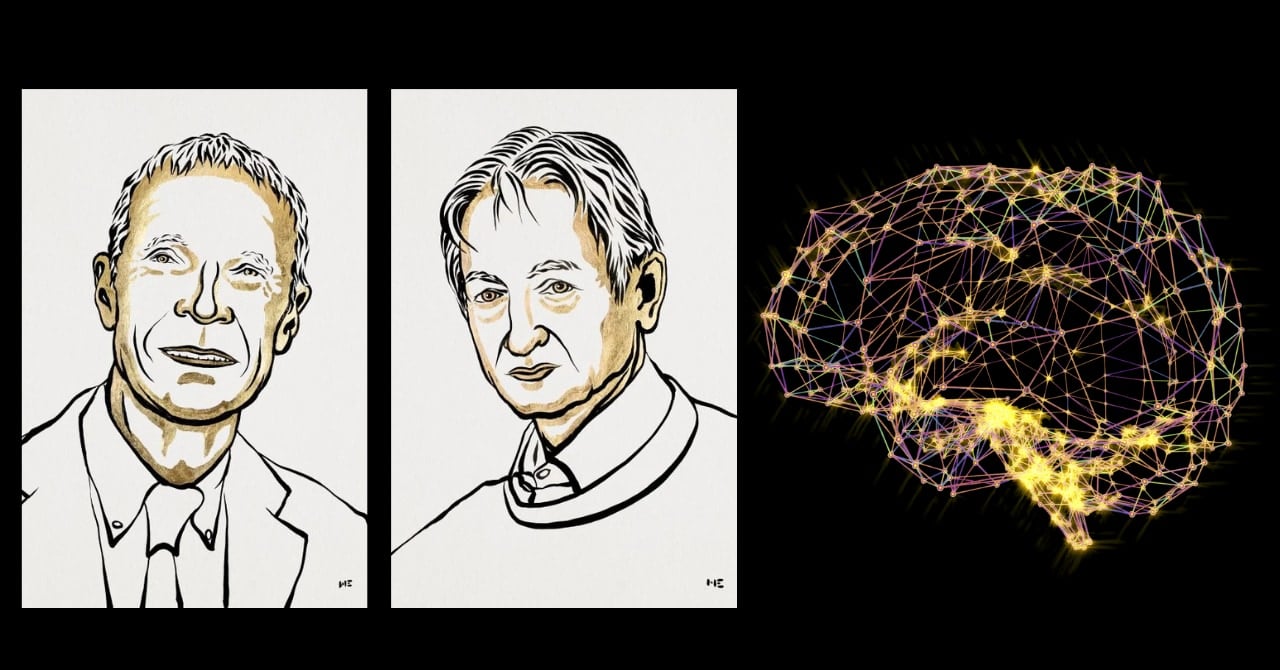

1982年、受賞者の1人であるプリンストン大学のホップフィールド氏は、「ホップフィールドネットワーク」という興味深い仕組みを開発しました。

このホップフィールドネットワークは、ネットワーク全体にエネルギーが蓄えられているという考え方を基礎としています。

そしてこのネットワークはエネルギー状態が最小になるように進化するように設定されました。

すると、ある点と点の接続の重みを一定に固定すると、特定のいくつかのネットワークパターンを再現できることが発見されます。

またこのパターン再現は耐性があり、ニューロンに相当するネットワーク内の点の活性度レベルに改変を加えても、正しく復元されることがわかりました。

ホップフィールド氏はこのプロセスを「記憶」や「判断(最適解)」と解釈しました。

私たちの脳でも、新しい情報が入るとニューロン間の結合強度が変化し、必要な記憶が定着します。

ホップフィールド氏は、接続の重みとエネルギーの法則に従って接続が変化するネットワークに、人間の脳と同じような可能性を見出したのです。

さらに幸いなことは「AIの冬」の時期にあっても、ホップフィールド氏の革命的発想を受け入れる人物が存在したことでした。

ネットワークに学習能力を発見

1985年、もう1人の受賞者であるコンピューター科学者のヒントン氏は、ホップフィールドネットワークをさらに発展させたボルツマンマシンを開発します。

ボルツマンマシンはニューロンにあたる点部分の状態変化に確率的な振る舞いを組み込みました。

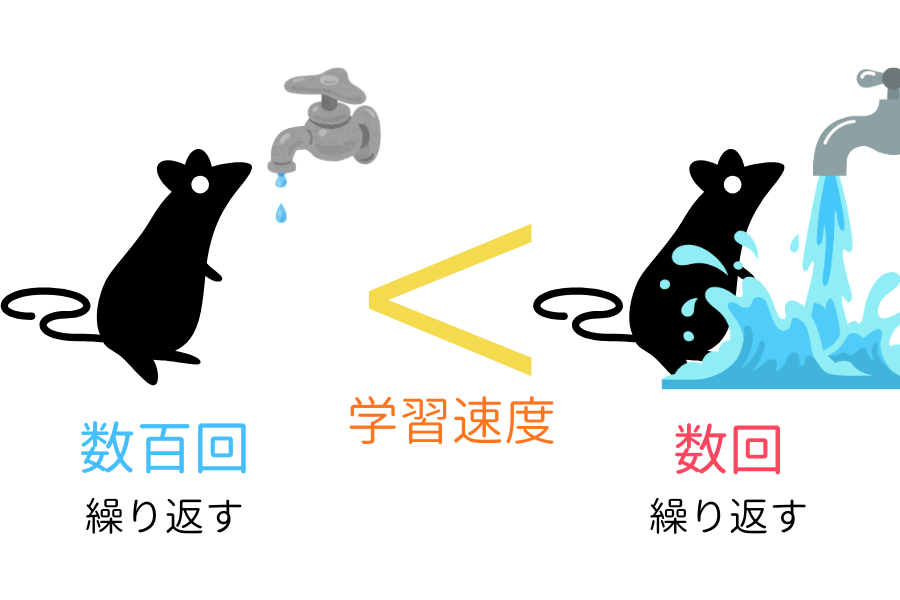

これにより、ネットワークは条件に基づき確率的にニューロンの状態を更新し、データの背後にある確率分布を学習できるようになりました。

既存のプログラムでは実行不可能だったデータのパターンや特徴を学習し、より高度な分析が行えるようになりました。

さらにボルツマンマシンの発展型では学習によって画像認識や画像分類などのより実用的な機能が実現します。

両名の発見は、ネットワーク内の物理現象をAIとして解釈するという点において、まさに物理学的なものと言えます。

また2人の発見を機に、AIの研究が徐々に加速し、現在の「AIの春」と言える状況が作られたという点も選考のポイントになったと考えられます。

![シルバーバック かわいい海の生きもの CUBE 2X2 キューブ ツーバイツー|海の生き物デザイン 立体パズル スピードキューブ 5cm 子ども〜大人向け 知育 ギフトに最適 ([バラエティ])](https://m.media-amazon.com/images/I/41EJOOLgGXL._SL500_.jpg)