AIのミスを理解し、対処する

AIのミスに対処するには、人間が自分たちにそうしたように、AIのミス傾向を理解して対策を講じるべきです。

スタンフォード大学の2022年11月の研究では、AIが犯すミスを予測し、対応するための手法を提示しています。

その1つが、プロンプト(AIへの指示文)の工夫です。

特に「自由回答型の質問形式」を使用すると、AIがより自然な応答を生成するとわかりました。

具体的には、選択肢を限定した形式(例:「TrueかFalseを選べ」)ではなく、「ジョンはどこに行ったのか?」のように、AIに自由に答えさせる質問形式が効果的でした。

さらに「同じ質問を異なる角度で繰り返し尋ねる手法」も効果的でした。

AIに対して異なるプロンプトを与え、それぞれの応答を得た後、それらを比較・評価して最適な結論を導き出すよう誘導するのです。

この手法なら、誤った回答が出力されることを最小限に抑えることができます。

これは、ある医師が複数の医師の意見を統合して最終的な診断を下すことに似ています。

実際に医療分野でAIが使用される場合も、複数の質問が投げかけられるケースがあります。

患者の症状について異なる形式で質問を行い、その回答をAIが統合することで、診断の精度を向上させるのです。

例えば、患者の症状を知りたい場合、あるプロンプトでは「症状の進行状況はどうか」と質問し、別のプロンプトでは「どの治療が最適か」を尋ねるといった具合です。

そして最後に、「患者はどんな症状ですか」と尋ねることで、AIはこれまでの情報を統合し、より精度の高い答えを示してくれます。

ここで得られる回答は、単に「どんな症状ですか」と1回質問する以上の精度であり、AIがミスする可能性が小さくなります。

もし、人間に対して、このような質問を繰り返し尋ねるなら、人間は「なぜ、同じようなことを何度も尋ねるのだ」と煩わしく感じるものです。

しかしAIにはそのような感情はありません。

まさにAIに特化したミス対策なのです。

ちなみに、別の分野の対策としては、「AIのミスを人間のミスに近づける」という手法もあります。

AIのミス傾向を、より人間らしいミス傾向に近づけていくというものであり、この分野でも研究が進められています。

いずれにせよ、現在見られるAIのミスを単なるエラーと見なすべきではありません。

その特性を理解し、適切に対処することで、AIは私たちの生活をより豊かにするツールとなるでしょう。

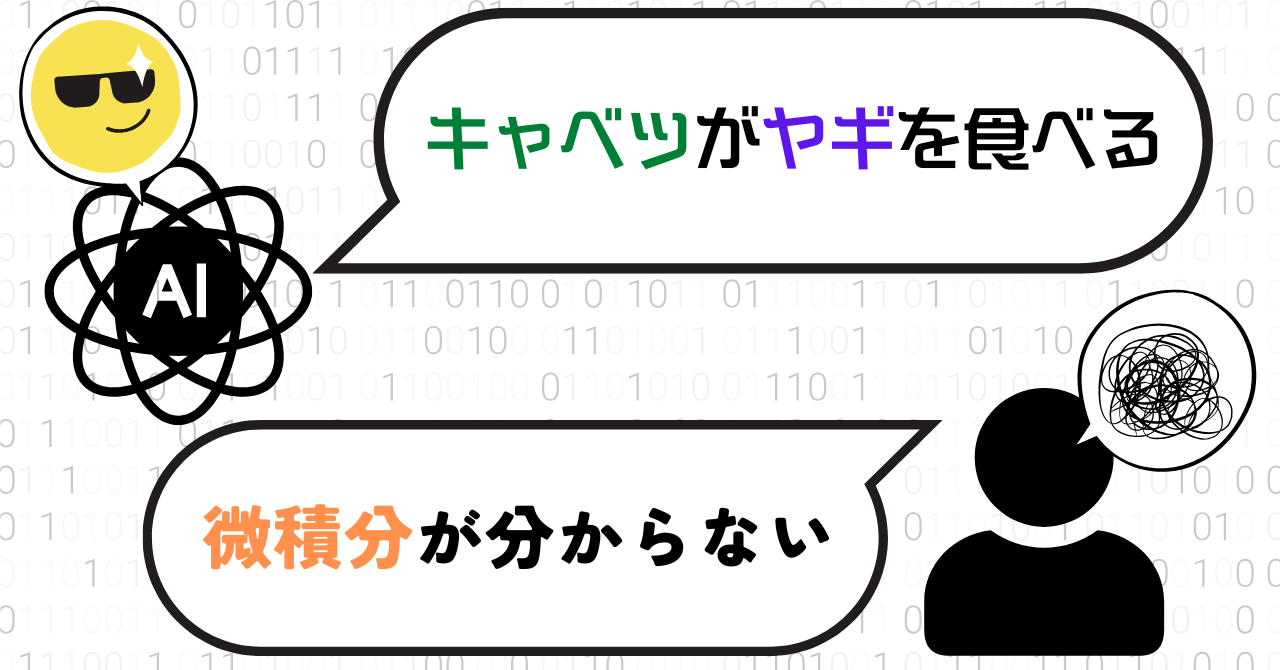

「キャベツがヤギを食べる」というような奇妙なミスが出力されたときこそ、そのミスに隠されたヒントを探ることで、AIと人間が共存する未来を築いていけるのです。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![BLACK WOLVES SAGA -Weiβ und Schwarz- for Nintendo Switch 【メーカー特典あり】 [予約特典]スリーブケース](https://m.media-amazon.com/images/I/51CzLR9fW3L._SL500_.jpg)

10パズルの問題を出すと、10パズルが何かを解説してくれた後にデタラメな答えが返って来て何か気味悪かった

まるで印南善一の最期…って言っても誰もわからないかもしれないが、AIさんには何かが見えてるんだろうな

この辺を根本的に解決するには一人の人間の模倣にこだわらず、設計人格と評価人格を作って会議させるとか、三権分立的な手法が必要になるんじゃないだろか?