欲望をコード化する時代の倫理

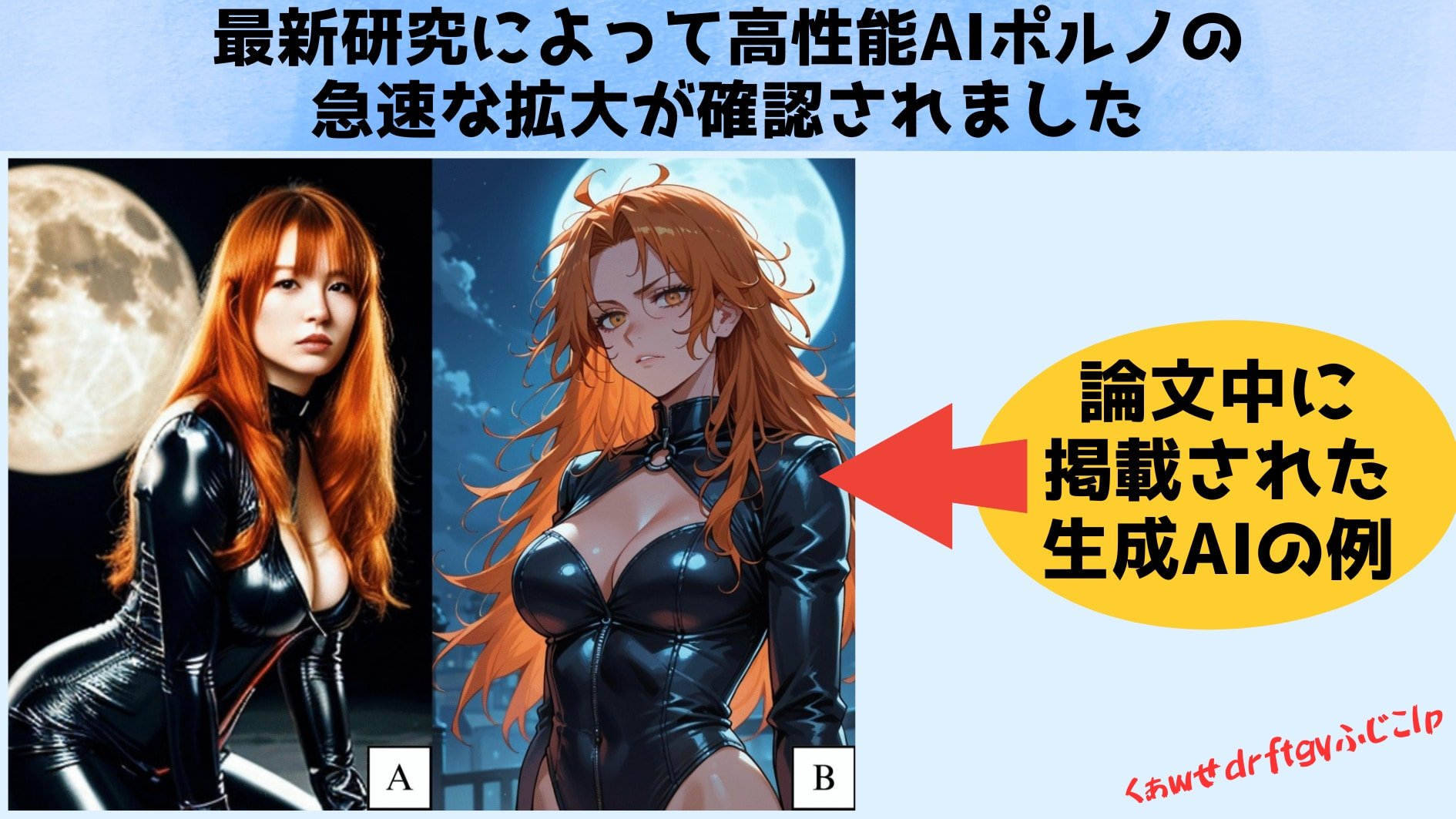

この研究が浮き彫りにしたAI生成ポルノの現状には、明るい展望と深刻なリスクの両面が存在します。

まず技術的な可能性という点では、AIポルノは従来にはなかった形で人々の性に関するニーズに応えるポテンシャルを秘めています。

専門家らは、この技術が上手く活用されれば性的少数者や身体的制約のある人々を含むより多様な人々に安全な空間で性教育を行うことや、セクシュアリティに関するオープンな対話を促すことに役立つかもしれないと指摘します。

また、セラピーや医学・心理学研究への応用も期待されています。

例えば性的トラウマや不安を抱えるクライアントに対して、セラピストがAIで個別に調整した性的シナリオを提示し徐々に慣れさせる曝露療法に利用したり、研究者が実験のために統一された条件の性的刺激をAIで生成して被験者に提示するといった使い方も考えられます。

AIが人間の性的体験をシミュレートし創造することで、教育・治療・研究の各分野に新たな道を拓く可能性があるのです。

一方、リスクや倫理的懸念も看過できません。

誰もが手軽に高度なポルノコンテンツを生み出せるということは、裏を返せば他者の権利や社会の安全に重大な影響を及ぼす危険性を孕んでいます。

例えば、本人の同意なく実在人物の顔写真をもとにわいせつな合成画像を作成する非合意ポルノはすでに世界的な問題となっています。

ある分析によれば、ネット上に存在するディープフェイク動画の98%がポルノ目的で作成されたもので、その被害者の99%は女性だったといいます。

AI生成ポルノはこうした不正利用をさらに容易にしてしまう恐れがあるのです。

今回の分析でも、簡単にヌード化やフェイススワップができてしまうサービスが確認されましたが、そこで本人の許可を厳格に求めていたサイトはわずか1つしかありませんでした。

またこのようなコンテンツに若年層がアクセスしてしまうリスクや、作成された人工物とはいえ出演者の「同意」が存在しないという倫理上の問題も新たに浮上しています。

さらに、AIが生成するコンテンツには児童虐待的なものなど違法または有害とされる題材が含まれる可能性も否定できません。

誰でも自在に作れてしまうからこそ、そうした危険なコンテンツが世に出回るハードルが下がってしまうという指摘です。

規制当局やプラットフォーム運営者にとっても、この状況は大きな課題を突きつけています。

技術が高度化し一般に普及するにつれ、その利用をどのように管理し、個人の権利をどう守るかは極めて難しい問題となるでしょう。

現行の法律やガイドラインはディープフェイクなど一部の問題には対応し始めていますが、完全に追いつくには至っておらず、AIポルノ全般を包含する包括的なルール作りはまだ手探りの段階です。

AI生成ポルノが開けたこの新天地を、私たちはどのように扱うべきなのでしょうか。

研究者たちは未来に対して慎重な楽観主義を抱いています。

Lapointe氏は「開発スピードの速さとユーザーがコンテンツを自在に制御できることには多くの懸念があります。違法または有害なコンテンツの生成・拡散を助長したり、若年層のアクセス、同意の問題などを招きかねません」と述べています。

しかし同時に、「適切な規制の下であれば、こうしたツールは性教育やセラピーなど多くの有益な応用への扉を開くこともできるでしょう。」とも語っています。

私たちは長期的に、この技術を倫理的な取り組みに役立て、危害を減らし責任ある利用を促進するための実証に基づいた枠組み作りを目指したいと考えています。

AI生成ポルノは確かに新たな扉を開きましたが、その先に広がる世界をどう形作っていくかは、これからの私たち次第なのかもしれません。

![よーく聞いてね!3つのヒントで学ぶ!どうぶつカード ([バラエティ])](https://m.media-amazon.com/images/I/51zT3OcliFL._SL500_.jpg)

![シルバーバック かわいい海の生きもの CUBE 2X2 キューブ ツーバイツー|海の生き物デザイン 立体パズル スピードキューブ 5cm 子ども〜大人向け 知育 ギフトに最適 ([バラエティ])](https://m.media-amazon.com/images/I/41EJOOLgGXL._SL500_.jpg)

男女が憎しみ合い争い合う時代にはぴったりなツールだと思うのですけどね。

>一部のサイトでは現実の人物の写真をアップロードして裸にしたり(いわゆる「ヌード化」)、顔をすげ替えたりするコンテンツ改変系の機能も提供されていますが、そうした機能の利用にあたって本人の同意を確認する仕組みを導入していたサイトは36中たった1つしか存在しませんでした

—

上記の、いわゆる性的ディープフェイクの被害が日本だけでなく、世界各国で社会問題となっており、最近では鳥取県が条例改正をして実在児童を対象とするディープフェイク性加害を禁止する規定を置いた(罰則はなし)。

昨年12月NHKのクローズアップ現代では、被害者も加害者も共に年齢層が低く、罪の意識のないまま加害に及んでいる実態が取材で明らかになった。具体的には、

クラスメイトの卒アルの顔写真から、Web上の脱衣系AIサービスで裸の画像を生成し、それらをDiscordやTelegram等の閉鎖的な密室SNS空間で取引する、「デジタル闇市場」が拡大しているのだ。まるで韓国のN番部屋事件のように。

児童ポルノ禁止法や刑法の名誉毀損罪など既存の法律ではカバーできないケースが存在するので、被害者救済の観点から一刻も早くアメリカのカリフォルニア州や韓国、英国、オーストラリアのように性的ディープフェイク特化の刑事罰立法をする必要がある。現在、国会でAI新法が審議中なので、この問題は今後も取り上げられるだろうと予想はしているが、実効性を確保するのが難しい。

(続き) >さらに約4割強のサイトでは動画の生成も可能であり、少数ながらアニメーションGIFや音声コンテンツ、VR(仮想現実)のシチュエーションに対応する例も見られました。

このように、今後は生成AIが扱えるメディアは多様化し、画像だけでなく、動画や脚本付きの映画やゲーム、仮想現実も生成可能になることが予想される。

シンギュラリティが実現するかどうかは置いといて、2030・40年代の将来的な技術発展を見据え、より包括的で実効性のある法整備と、あらゆる世代を対象とした継続的なリテラシー教育が不可欠であると言える。10年前、ディープフェイク技術の発展やアクセスの容易性、画像・動画生成AIの台頭を正確に予測できた人はどれだけいるだろうか。

体験型VRや没入型メタバースの特性を踏まえて、アバターを用いた性加害

(今の画像・動画生成AIのように、3Dアバター生成AI、わいせつ目的でのVR用ドッペルゲンガー生成AIが登場する可能性も考慮する)や、

よりリアルな性的ディープフェイクによる被害(映画生成AI, ゲーム生成AI, メタバース生成AIなどのマルチメディア・マルチモーダル生成AIのディープフェイク版の登場も考慮する)

を想定した法規制や教育内容の検討が、今後の重要な課題となる。